信息论为什么是正确的?我认为数学或者科学必须有一个坚实的基础,比如说欧几里得的《几何原本》的基础就是二十多条公理,这些公

紫衣天使2022-10-04 11:39:542条回答

紫衣天使2022-10-04 11:39:542条回答

信息论为什么是正确的?

我认为数学或者科学必须有一个坚实的基础,比如说欧几里得的《几何原本》的基础就是二十多条公理,这些公理连3岁小孩都很容易理解(比如平行线不会相交,整体大于部分等),再比如牛顿的力学体系,其基础是牛顿三定律,可以通过试验的方式证明其正确.

信息论的基础是信息量,及I(a)=-log p(a),为什么其是正确的?为什么不能把其定义为I(a)=-log p(a)+10或者I(a)=1/ p(a) 呢?

如果说不清楚可以给一个链接或者是一本书的某几页,我自己去查

我认为数学或者科学必须有一个坚实的基础,比如说欧几里得的《几何原本》的基础就是二十多条公理,这些公理连3岁小孩都很容易理解(比如平行线不会相交,整体大于部分等),再比如牛顿的力学体系,其基础是牛顿三定律,可以通过试验的方式证明其正确.

信息论的基础是信息量,及I(a)=-log p(a),为什么其是正确的?为什么不能把其定义为I(a)=-log p(a)+10或者I(a)=1/ p(a) 呢?

如果说不清楚可以给一个链接或者是一本书的某几页,我自己去查

已提交,审核后显示!提交回复

共2条回复

zhu-atom 共回答了27个问题

zhu-atom 共回答了27个问题 |采纳率92.6%- 可以自己定义的,但是必须满足几个条件,具体可以查看Wikipedia.

NN的,度娘老说我包含不能发表的东西

本来我敲了大段字,度娘老是说我包含不能发表的,于是删减成这样了.后面就没了,不高兴敲了呵呵

给个链接,你自己去看吧,多看些英文的对自己很有帮助的,千万别看中文版的

以及 - 1年前

deer2006 共回答了1个问题

deer2006 共回答了1个问题 |采纳率- 有定义,在它中.寻求证明高中数学必修一

- 1年前

相关推荐

- 信息论与编码学的是啥?

Chanelcoco1年前1

Chanelcoco1年前1 -

穿着简单的 共回答了13个问题

穿着简单的 共回答了13个问题 |采纳率100%信息论与编码主要分两部分,前几章主要讲信息方面的,后几章讲编码方面的.由信源,信道到信宿,讲信息符号的传播.为了传播的安全性,对其进行编码加密等.我们刚学完这门课,不是很难.祝你天天好成绩.1年前查看全部

- 信息论与编码技,问:信息速率失真函数R(D)是表示什么具体的物理意义?定义域0

巫师的猫儿1年前1

巫师的猫儿1年前1 -

贾正吕 共回答了16个问题

贾正吕 共回答了16个问题 |采纳率100%R(D)就是在满足保真度准则下,实验信道输入与输出之间的最小平均互信息.

其实就是说是通过这个来确定信道的.1年前查看全部

- 信息论发展的第3阶段是经典信息论还是广义信息论

7_冷1年前1

7_冷1年前1 -

送479个拥抱 共回答了30个问题

送479个拥抱 共回答了30个问题 |采纳率83.3%广义信息论1年前查看全部

- 信息论与编码 检验矩阵的问题某(n,k)线性二元码的全部码字:000000 000111 011001 011110 1

信息论与编码 检验矩阵的问题

某(n,k)线性二元码的全部码字:000000 000111 011001 011110 101011 101100 110010 110101 求此码的生成矩阵G和此码的校验矩阵H? 杰杰帅1年前3

杰杰帅1年前3 -

曾围 共回答了25个问题

曾围 共回答了25个问题 |采纳率92%一共8个许用码字,显然信息位是3位,校验比特6-3=3位.

其实你给的是系统码,因为这8个码字中,后三位分别是:

000 111 001 110 011 100 010 101,正好是0到7的二进制数,那就简单了.

生成矩阵G只要把100 010 001的码字挑出来,放在一起组成的就是生成矩阵.

G=

101100

110010

011001

你可以试一下,比如信息位是[011],那编码出来就是:

[011]*G=101011,显然是对的.

校验矩阵么就是单位阵加上G的左半边的转置

H=

100110

010011

0011011年前查看全部

- 信息论(傅祖云)版,3.15证明无损信道的充要条件是信道的传递矩阵中每一列有一个也只有一个非零元素.

janebaby1年前1

janebaby1年前1 -

挥剑斩烟烟无痕 共回答了18个问题

挥剑斩烟烟无痕 共回答了18个问题 |采纳率88.9%证明:

∵传递矩阵每一列有且仅有一个非零元素

∴表明每个输出符号Y

仅与一个输入符号Z对应

则

P(Z|Y)=1

∴损失熵

H(Z|Y)=0

由定义知是无损信道.

反之,以上每步均可逆.1年前查看全部

- 信息论 关于量的交换性质 H(X|Y)等于H(Y|X)吗 H(X,Y)等

信息论 关于量的交换性质

H(X|Y)等于H(Y|X)吗

H(X,Y)等于H(Y,X)吗

I(X;Y) 等于I(Y;X)吗

I(X;Y|Z)等于I(Y;X|Z)吗 乖乖芋头1年前1

乖乖芋头1年前1 -

山里看花 共回答了16个问题

山里看花 共回答了16个问题 |采纳率87.5%H(X|Y)等于H(Y|X)吗,不一定,H(X|Y)=H(X)-I(X;Y),H(Y|X)=H(Y)-I(X;Y)

H(X,Y)等于H(Y,X),H(X,Y)=H(Y,X)=H(X)+H(Y)-I(X;Y)

I(X;Y) 等于I(Y;X)

I(X;Y|Z)等于I(Y;X|Z),表示Z已知情况的下的互信息量1年前查看全部

- 信息论中,为什么熵越大信息量越小?

信息论中,为什么熵越大信息量越小?

据说:在信息论中,熵可用作某事件不确定度的量度.信息量越大,体系结构越规则,功能越完善,熵就越小.

但是:一个东西越混乱,描述它所需的信息量不是越大吗?为什么不是这样?例如一个新硬盘和装得乱七八糟的硬盘,哪个更混乱?哪个信息量大?我是个外行,你可以换个例子

到底信息量和混乱度是用什么衡量的?为什么那样衡量? n125qiusen1年前1

n125qiusen1年前1 -

浪人老K 共回答了16个问题

浪人老K 共回答了16个问题 |采纳率93.8%熵是描述系统混乱的量,熵越大说明系统越混乱,携带的信息就越少,熵越小说明系统越有序,携带的信息越多.你要现确定系统,再来描述.你的例子,可以这样理解,同样大的硬盘,熵越大什么坏了的硬盘越多,他可以承载的信息越少,熵越小意味着坏掉的硬盘越少,可以承载的信息量越大.1年前查看全部

- 信息论的应用有哪些

zsak411年前1

zsak411年前1 -

哈搭楼神 共回答了15个问题

哈搭楼神 共回答了15个问题 |采纳率100%信息论是研究信息的产生、获取、变换、传输、存贮、处理识别及利用的学科.信息论还研究信道的容量、消息的编码与调制的问题以及噪声与滤波的理论等方面的内容.信息论还研究语义信息、有效信息和模糊信息等方面的问题.信息论有狭义和广义之分.狭义信息论即申农早期的研究成果,它以编码理论为中心,主要研究信息系统模型、信息的度量、信息容量、编码理论及噪声理论等.广义信息论又称信息科学,主要研究以计算机处理为中心的信息处理的基本理论,包括评议、文字的处理、图像识别、学习理论及其各种应用.广义信息论则把信息定义为物质在相互作用中表征外部情况的一种普遍属性,它是一种物质系统的特性以一定形式在另一种物质系统中的再现.广义信息论包括了狭义信息论的内容,但其研究范围却比通讯领域广泛得多,是狭义

信息论在各个领域的应用和推广,因此,它的规律也更一般化,适用于各个领域,所以它是一门横断学科.广义信息论,人们也称它为信息科学.

信息和控制是信息科学的基础和核心.70年代以来,电视、数据通信、遥感和生物医学工程的发展,向信息科学提出大量的研究课题,如信息的压缩、增强、恢复等图像处理和传输技术,信息特征的抽取、分类和识别的模式、识别理论和方法,出现了实用的图像处理和模式识别系统.1年前查看全部

- 信息论 比特奈特的换算关系信息量度量中,若以2为底为比特,以e为底为奈特.其中-log p(xi)=[1/ln2)]*-

信息论 比特奈特的换算关系

信息量度量中,若以2为底为比特,以e为底为奈特.其中-log p(xi)=[1/ln2)]*-lnp(xi).这不就表明1奈特=ln2倍的比特吗,应该是0.693比特啊,怎么是1/ln2=1.44比特呢,我哪里理解错了? 舞动春风1年前1

舞动春风1年前1 -

兵进鹏城 共回答了22个问题

兵进鹏城 共回答了22个问题 |采纳率90.9%对数的换算关系:log(a)b=lnb/lna

其中log(a)表示以a为底的对数,所以log(2)[p(xi)]=ln[p(xi)]/ln2

也即-ln[p(xi)]=ln2 *[- log(2)[p(xi)] ]1年前查看全部

- 信息论 信息量 信息熵信息论是否先验的认为信息量、信息熵等可以表明事物的信息的“多少”,并通过一系列的极值等方式来得到定

信息论 信息量 信息熵

信息论是否先验的认为信息量、信息熵等可以表明事物的信息的“多少”,并通过一系列的极值等方式来得到定理? 哦撒1年前1

哦撒1年前1 -

IT_Leah 共回答了23个问题

IT_Leah 共回答了23个问题 |采纳率91.3%是的

信息量、信息熵可以衡量事件或信源信息的“多少”;至于你说的定理,那要具体看是什么定理了,信息论这门学科中有许多定理.1年前查看全部

- 求教:信息论中关于疑义度H(XlY)与噪声熵H(YlX)该如何理解

求教:信息论中关于疑义度H(XlY)与噪声熵H(YlX)该如何理解

H(X/Y)是已表示收到变量Y后,对随机变量X仍然存在的不确定度.那为什么说他是损失的信息量,如果这样的话,那么I(X;Y)表示了什么(老师说I(X;Y)表示的是由X到Y过信道所改变的信息量,那么这不就是损失的信息量吗?)

另外,H(YlX),就更令我费解了,如果说H(XlY)是以Y为观测点,收到Y后X的不确定度,那H(XlY)以X为观测点又如何理解?噪声熵和疑义度有什么区别?最近在学信息论与编码,好纠结~ xulei20081年前1

xulei20081年前1 -

南美阳光坏小子 共回答了18个问题

南美阳光坏小子 共回答了18个问题 |采纳率94.4%关于I(X;Y),它是表示一个随机变量Y给出的关于另一个随机变量X的信息量.可能是你们老师没有说清楚,它的物理意义是:信道两端有两个随机变量X和Y,由Y提取到得关于X的信息量,并非损失的信息量.

这里不是指H(YlX),H(YlX)是不能用观察者的立足点来解释的(这个你从条件熵的定义想想就知道了).你说的应该是I(X;Y).这就是信道两端以谁为“信源”,在哪边“接收”的问题了(也就是你所说的观测点).1年前查看全部

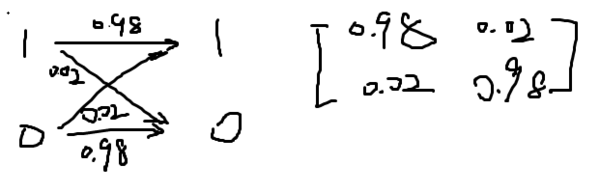

- 信息论与编码有一个二进制对称信道,其信道在传输信息的过程中,正确传输的概率是0.98,错误传输的概率是0.02.设该信道

信息论与编码

有一个二进制对称信道,其信道在传输信息的过程中,正确传输的概率是0.98,错误传输的概率是0.02.设该信道以每秒1500个二元符号的速率传输输入的符号 .现有一消息序列共有14000个二元符号,并设在这个消息中P(0)=P(1)= ½ .

(1)画出该二进制对称信道的传输特性图,并写出其信道矩阵.

(2)问从信息传输的角度来考虑,10秒内能否将这消息序列无失真地传送完.

又被tt1年前1

又被tt1年前1 -

verra586 共回答了19个问题

verra586 共回答了19个问题 |采纳率89.5%1年前查看全部

- 什么是信息论

nannan10191年前1

nannan10191年前1 -

1山贼 共回答了24个问题

1山贼 共回答了24个问题 |采纳率91.7%信息论是由美国数学家香农创立的,它是用概率论和数理统计方法,从量的方面来研究系统的信息如何获取、加工、处理、传输和控制的一门科学.信息就是指消息中所包含的新内容与新知识,是用来减少和消除人们对于事物认识的不确定性.信息是一切系统保持一定结构、实现其功能的基础.狭义信息论是研究在通讯系统中普遍存在着的信息传递的共同规律、以及如何提高各信息传输系统的有效性和可靠性的一门通讯理论.广义信息论被理解为使运用狭义信息论的观点来研究一切问题的理论.信息论认为,系统正是通过获取、传递、加工与处理信息而实现其有目的的运动的.信息论能够揭示人类认识活动产生飞跃的实质,有助于探索与研究人们的思维规律和推动与进化人们的思维活动.1年前查看全部

- 信息论与编码要什么基础

福满全天下1年前1

福满全天下1年前1 -

桀一骜 共回答了21个问题

桀一骜 共回答了21个问题 |采纳率90.5%概率论与数理统计 -> 离散数学 -> 信息论与编码1年前查看全部

- 信息科学、信息论以及信息技术的区别与联系

79553111年前1

79553111年前1 -

BOB高石 共回答了18个问题

BOB高石 共回答了18个问题 |采纳率94.4%信息科学是指以信息为主要研究对象,以信息的运动规律和应用方法为主要研究内容,以计算机等技术为主要研究工具,以扩展人类的信息功能为主要目标的一门新兴的综合性学科.信息科学由信息论、控制论、计算机科学、仿生学...1年前查看全部

- 信息一词在《中国大百科全书》中的意思和信息论奠基人之一香农的意思,

信息一词在《中国大百科全书》中的意思和信息论奠基人之一香农的意思,

就是初一年级的信息技术书上的,要是能回答书上的全部问题,那就更好啦! hymny1年前1

hymny1年前1 -

yayacai_80 共回答了17个问题

yayacai_80 共回答了17个问题 |采纳率88.2%辞海是:1音讯2通信系统传输和处理的对象,泛指消息和信号的具体内容和意义. 大百科的我不知道了!香农说:信息是用来消除不确定的东西. 维钠说:信息就是信息,不是物质,也不是能量. 钟义信说:从本质上说,信息技术...1年前查看全部

- 被人们尊称为“信息论之父”的是(A)布尔 (B)摩尔 (C)冯•诺依曼 (D)申农我只知道c是计算机之父~

被人们尊称为“信息论之父”的是

(A)布尔 (B)摩尔 (C)冯•诺依曼 (D)申农

我只知道c是计算机之父~ 白天懂夜的黑1年前1

白天懂夜的黑1年前1 -

Avina_Wang 共回答了23个问题

Avina_Wang 共回答了23个问题 |采纳率91.3%D 又译作 香农1年前查看全部

- 请证明急求,信息论的13个球其中一个重量与其他的不同,在只有天平没发麻的情况下,最少用几次称出

台风级核潜艇1年前2

台风级核潜艇1年前2 -

绝对气ll你 共回答了9个问题

绝对气ll你 共回答了9个问题 |采纳率100%Log2(13)越等于4次.1年前查看全部

- 应用回归分析、矩阵分析、模糊数学、信息论与密码这几门课哪一门和物理,特别是量子物理的关系最大?

zhaowangok1年前1

zhaowangok1年前1 -

风景阳台 共回答了29个问题

风景阳台 共回答了29个问题 |采纳率89.7%应用回归分析、矩阵分析、模糊数学都是物理的数学基础方法,前两个相对应用更多

而对于量子物理,显然矩阵应用更多,薛定谔和海森堡分别采用的就是波函数和矩阵的方式来描述

信息论与密码更应该算是物理的一个方面,而现在的量子密码学、量子信息学是密码学、信息学在量子物理引出的交叉学科,也是现今热门的内容1年前查看全部

大家在问

- 1一元一次方程 3y-15=y-19

- 2如图所示电路,电源电压为12V,闭合开关S,移动滑动变阻器的滑片P,小灯泡始终不亮,电流表示数为零,电压表示数为12V,

- 3when will you cousin____?

- 4给你一个条件A+B=C,要求证明1=99谢谢了,

- 5下列各项中,标点符号的使用合乎规范的一项是 (

- 6He is going to travel by plane rather than by train.(否定形式)

- 7My heart may be belongs to

- 8一辆汽车3小时行150千米,平均每小时行150千米的几分之几,平均每小时行()千米.

- 9当北京时间为2011年1月1日0:00时,全球未进入2011年的地区范围 A.多一半的经度 B.少一半的经度 C.恰好一

- 105/6*4/13+5/18*6/13 简算过程

- 11若X加Y加Z等于2乘以括号根号X加根号Y减1加根号Z减2求X.Y.Z的值

- 12有没有通用的英文作文?就是不管什么题都可以用来作议论文写,字数最好在100字以上

- 13表达志向的名言4句!

- 14用10以内的俩个质数组成一个俩位数 这个俩位数是2和3的公倍数

- 15苍蝇和沮都是我们卫生的大敌,但它们形态结构和生活环境截然不同,它们是两种不同的生物吗?它们之间有什么关系呢?